Därför behöver du vara källkritisk mot ChatGPT och andra generativa AI-verktyg

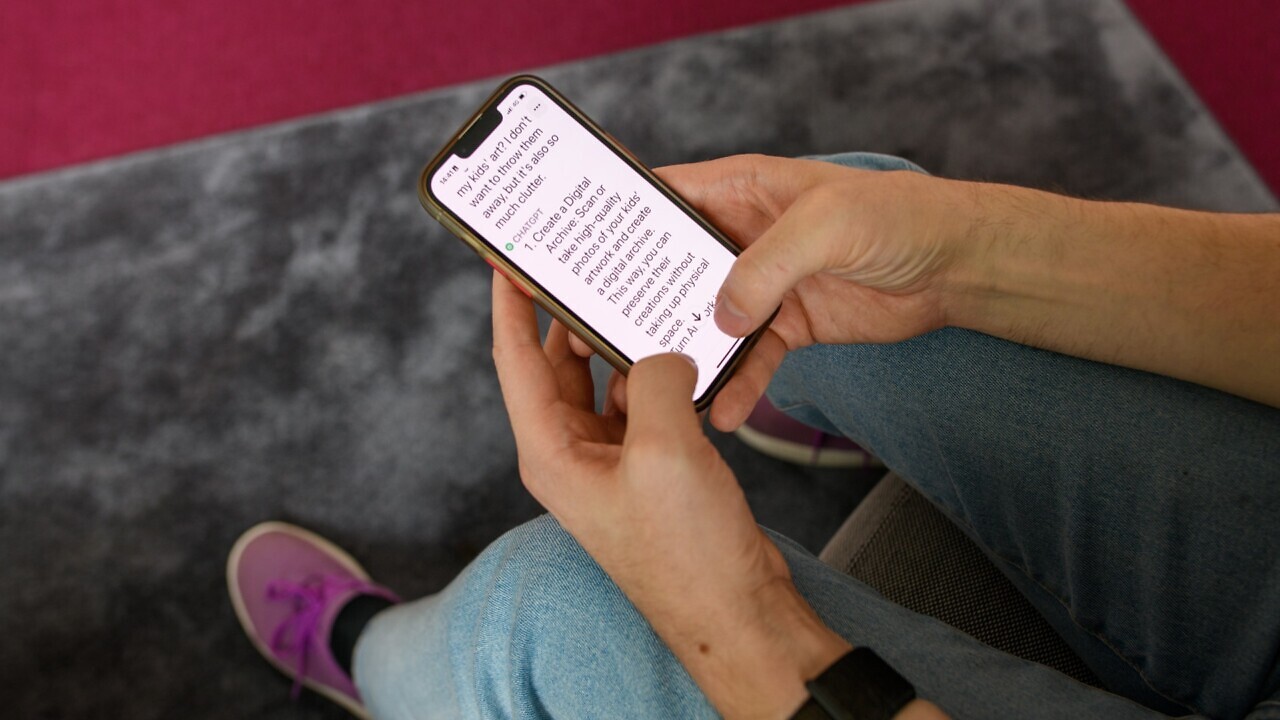

ChatGPT och andra generativa AI-verktyg håller på att förändra hur vi söker information på nätet.

Med sökmotorer får vi sökresultat i form av länkar, som vi kan granska, men med generativ AI får vi färdiga svar – ofta utan tydliga källor och med risk för fel.

I den här kursen får du lära dig varför du behöver vara källkritisk mot generativa AI-verktyg, men också hur ChatGPT kan hjälpa dig att vara källkritisk.

Vad är generativ AI?

Generativ AI är AI-verktyg som används för att generera – alltså skapa – något nytt utifrån vad den tränats på. Det kan vara text, bild, video eller ljud.

Exempel på populära generativa AI-verktyg är ChatGPT för text och DALL-E för bilder.

Hur fungerar ChatGPT?

ChatGPT är ett av de mest kända AI-verktygen och är utvecklat för att efterlikna hur människor skriver och pratar.

ChatGPT använder en så kallad språkmodell, som är ett program som tränats genom att läsa och analysera enorma mängder text från internet. Genom denna träning har språkmodellen lärt sig hur texter brukar se ut och kan gissa vilka ord som sannolikt kommer härnäst i en mening. På så sätt kan den skapa svar som låter naturliga.

När du ger en instruktion eller ställer en fråga använder ChatGPT din input för att skapa ett svar som hänger ihop med det du skrivit.

Kan jag lita på att ChatGPT svarar rätt på mina frågor?

Nej, du kan inte lita på att ChatGPT alltid ger korrekta svar. ChatGPT är en gissningsmaskin, inte en sökmotor eller faktabank. Även om det verkar som att ChatGPT "vet" allt, kan du ibland få felaktiga svar. Därför är det viktigt att alltid dubbelkolla påståenden från ChatGPT med pålitliga källor.

ChatGPT kan dessutom bara ge svar utifrån det material som språkmodellen tränats på. Om majoriteten av texterna den läst beskriver läkare som män och städare som kvinnor, kommer den troligtvis återge samma mönster i sina svar. ChatGPT är i sig själv inte fördomsfull, men kan alltså ändå förstärka fördomar, stereotyper och kulturella normer som finns i de texter den tränats på.

Kan ChatGPT hjälpa mig att vara källkritisk?

Ja, du kan använda ChatGPT på ett sätt som gör det lättare att vara källkritisk mot svaren du får.

ChatGPT utvecklas hela tiden och kan nu både söka på internet och redovisa sina källor. Här är ett exempel på hur du kan instruera ChatGPT:

"Jag vill veta vilka Internetstiftelsen är. Sök på internet och redovisa källorna."

På det här sättet kan du få både svaret och länkar till källorna så att du själva kan dubbelkolla om informationen är pålitlig.

Hur kan jag avgöra om en bild är AI-genererad eller inte?

Tekniken utvecklas snabbt, och det blir allt svårare att avslöja AI-genererade texter, bilder och video.

För att visa hur svårt det är kan du försöka avgöra om bilderna på den här sidan är fotografier eller AI. Du hittar facit på nästa sida.

Det bästa sättet att inte bli lurad är att ha koll på grundläggande källkritik och veta hur man undersöker följande:

- Vem står bakom informationen?

- Vilka bevis finns för att informationen stämmer?

- Vad säger andra källor om avsändaren och dess påståenden?

I slutet på den här kursen hittar du länkar till andra kurser där du kan lära dig mer om detta.

Facit: fotografi eller AI?

Här är rätt svar på frågan om bilderna är fotografi eller AI.

- AI

- Fotografi

- AI

- AI

Hur många rätt hade du?

Kan AI-verktyg användas för att sprida falsk information?

Ja, generativa AI-verktyg kan användas för att snabbt skapa och sprida stora mängder falsk information. Förutom textverktyg, som ChatGPT, finns AI-tjänster som kan användas för att skapa vilseledande bilder och videor.

Många experter på desinformation och källkritik varnar för två stora risker med generativ AI:

- Mer falsk information – AI gör det enklare att skapa vilseledande texter, bilder och videor. Det riskerar att öka mängden falsk information på nätet kraftigt, vilket i sin tur gör det svårare att hitta pålitlig information.

- Svårare att lita på något alls – När AI kan skapa trovärdiga falska bilder, videor och dokument blir det inte bara svårare att skilja sant från falskt. Det blir också lättare att påstå att äkta material är falskt. Det kan få fler att ifrågasätta och tvivla på all information, även sådan som faktiskt är sann.

Finns det verktyg på nätet för att upptäcka AI-genererat innehåll?

Ja, det finns verktyg på nätet som analyserar texter, bilder och videor för att avgöra om de är skapade med generativ AI.

För att hitta sådana verktyg kan du till exempel söka på "AI detection tool for images/videos/texts" eller fråga ChatGPT om rekommendationer.

Men kom ihåg att dessa verktyg inte är helt tillförlitliga. AI utvecklas snabbt och verktygen kan misslyckas med att upptäcka AI-genererat innehåll. Ibland kan även material skapat av människor flaggas felaktigt som AI. Därför bör resultaten ses som en vägledning snarare än en absolut sanning. De här verktygen är bara ett komplement till grundläggande källkritik.

Bra! Nu vet du varför du behöver vara källkritisk mot ChatGPT och AI-genererat innehåll!

- ChatGPT är en "gissningsmaskin", den vet inget och kan ibland ge felaktiga svar. Därför behöver du dubbelkolla påståenden med pålitliga källor.

- ChatGPT kan förstärka fördomar, stereotyper och kulturella normer som finns i de texter den tränats på.

- Du kan be ChatGPT att redovisa sina källor. Då blir det lättare att vara källkritisk och dubbelkolla information.

- Det är svårt att avgöra om texter, bilder och video är AI-genererade eller inte. Det finns verktyg på nätet som kan hjälp dig med detta, men de bör endast användas som ett komplement till grundläggande källkritik.

Vill du lära dig mer?

Den här kursen är den nionde och sista i en serie kurser. I listan nedanför kan du se alla kurser och andra tips om du vill lära dig mer om källkritik.

Alla snabbkurser om källkritik

- Källkritik på sociala medier – en introduktion

- Tre frågor som gör dig bättre på digital källkritik

- Så undersöker du en avsändare på rätt sätt

- Därför behöver du dubbelkolla information med andra källor

- Så dubbelkollar du information med hjälp av källtillit

- Så dubbelkollar du information med hjälp av en sökmotor

- Så dubbelkollar du information med Wikipedia på bästa sätt

- Så undersöker du bilder med hjälp av bildsökning

- Därför behöver du vara källkritisk mot ChatGPT och andra generativa AI-verktyg

Mer om digital källkritik

- Läs artiklar om källkritik på Internetkunskap

- Läs artiklar om AI på Internetkunskap

- Tips på fördjupning: Navigating Digital Information – Crash Course (10 avsnitt på engelska)

- Stora verktygslådan för viralgranskare av Källkritikbyrån